Crawl error: Czym jest, jak go znaleźć i skutecznie naprawić?

W dynamicznym świecie SEO, gdzie każda sekunda i każdy bajt danych mają znaczenie, istnieje cichy wróg, który może sabotować Twoje wysiłki, zanim jeszcze zdążysz zobaczyć ich owoce. Mowa o crawl error, Czyli błędzie indeksowania. To techniczny problem, który brzmi skomplikowanie, ale jego konsekwencje są bardzo realne: utrata widoczności w wynikach wyszukiwania, zmarnowany potencjał i frustracja zarówno dla Ciebie, jak i dla Twoich użytkowników. Jako właściciel strony, marketer czy specjalista SEO, zrozumienie, czym jest crawl error, gdzie go szukać i jak go naprawić, to absolutna podstawa skutecznej strategii online. Ten artykuł to kompleksowy przewodnik, który przeprowadzi Cię przez labirynt błędów indeksowania, dając Ci narzędzia i wiedzę do przejęcia pełnej kontroli nad technicznym zdrowiem Twojej witryny.

Czym dokładnie jest crawl error i dlaczego powinien cię obchodzić?

Zanim zagłębimy się w naprawianie, musimy zrozumieć istotę problemu. Wyobraź sobie, że Googlebot (robot indeksujący Google) to niezwykle sumienny bibliotekarz, który próbuje skatalogować każdą książkę (stronę internetową) w największej bibliotece świata (internecie). Aby to zrobić, musi najpierw do każdej książki dotrzeć i móc ją przeczytać. Crawl error Występuje dokładnie w tym momencie – gdy robot napotyka przeszkodę, która uniemożliwia mu dostęp do strony lub jej zrozumienie. To jak zamknięte drzwi, zepsuty zamek lub błędna informacja o lokalizacji książki na półce.

Dlaczego jest to tak istotne? Ponieważ proces, który prowadzi do pojawienia się Twojej strony w wynikach wyszukiwania, składa się z dwóch głównych etapów:

- Crawling (Skanowanie/Indeksowanie): Proces, w którym roboty wyszukiwarek, takie jak Googlebot, odkrywają nowe i zaktualizowane strony, podążając za linkami.

- Indexing (Indeksowanie w bazie danych): Proces analizowania i przechowywania informacji o zeskanowanych stronach w ogromnej bazie danych Google. Dopiero strona, która trafi do indeksu, może pojawić się w wynikach wyszukiwania.

Crawl error Przerywa ten proces na samym początku. Jeśli Googlebot nie może uzyskać dostępu do Twojej strony, ta strona nigdy nie zostanie zaindeksowana. A strona, której nie ma w indeksie Google, dla potencjalnych użytkowników po prostu nie istnieje.

Konsekwencje ignorowania błędów indeksowania

Zaniedbanie problemu crawl error to prosta droga do poważnych problemów z SEO. Oto najważniejsze konsekwencje:

- Brak stron w indeksie: Najbardziej oczywisty skutek. Nowe artykuły na blogu, kluczowe strony produktowe czy ważne landing page mogą nigdy nie dotrzeć do potencjalnych odbiorców, ponieważ Google o nich nie wie.

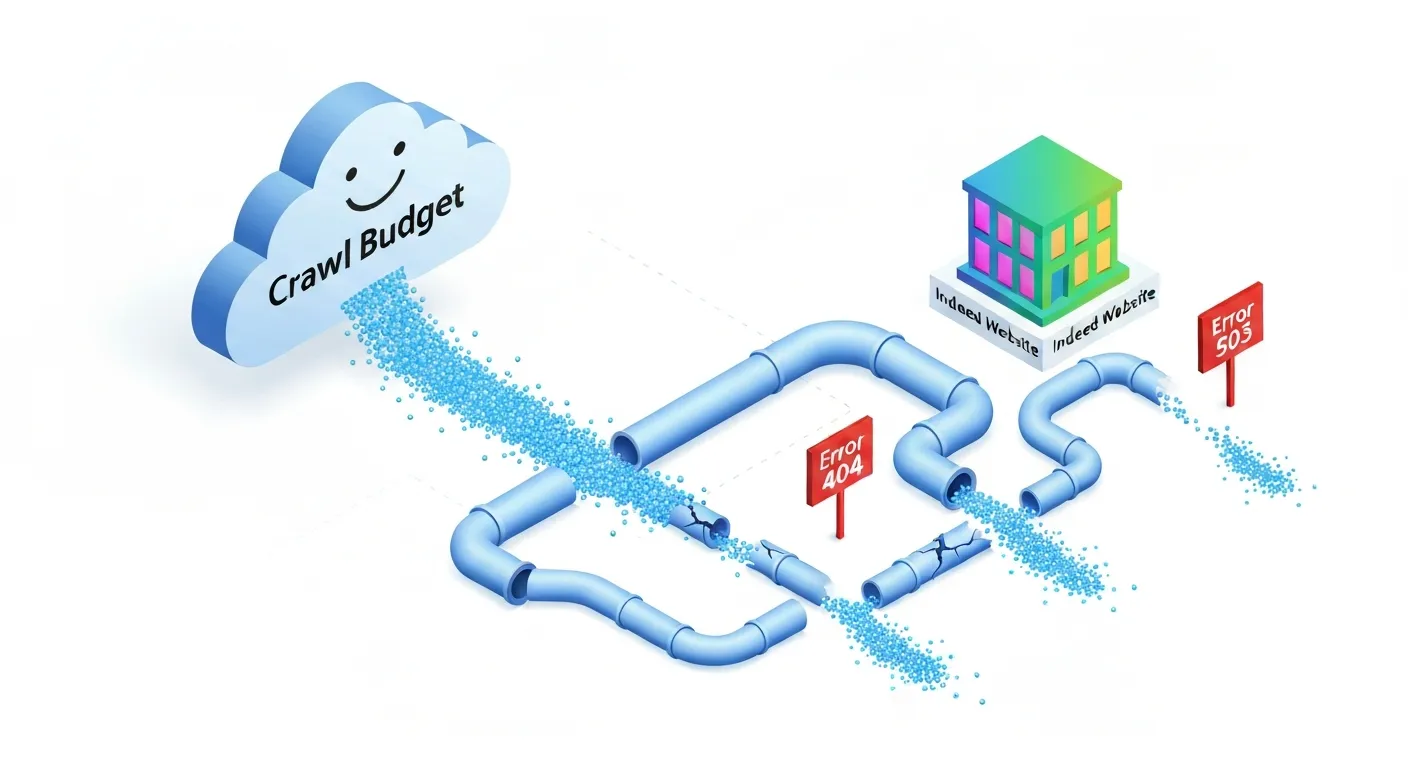

- Marnowanie budżetu indeksowania (Crawl Budget): Każda witryna ma przypisany przez Google tzw. „budżet indeksowania” – czyli określoną liczbę zasobów (czasu i żądań), które roboty poświęcą na przeskanowanie Twojej strony. Każde żądanie zakończone błędem to zmarnowana część tego cennego budżetu, który mógłby zostać wykorzystany na skanowanie ważnych, działających podstron.

- Negatywny wpływ na doświadczenie użytkownika (UX): Wiele błędów indeksowania, zwłaszcza błędy 404 (nie znaleziono strony), jest widocznych również dla użytkowników. Kliknięcie w link prowadzący donikąd jest frustrujące i podważa zaufanie do Twojej marki.

- Spadek w rankingach: Choć pojedynczy błąd 404 nie zniszczy Twojej pozycji, duża liczba błędów lub krytyczne błędy serwera (5xx) są dla Google sygnałem, że witryna jest zaniedbana lub ma problemy techniczne. W dłuższej perspektywie może to prowadzić do obniżenia autorytetu domeny i spadku w rankingach.

Rodzaje błędów indeksowania (crawl errors), które musisz znać

Błędy indeksowania nie są monolitem. Przybierają różne formy, a każda z nich wymaga innego podejścia. Zasadniczo możemy je podzielić na dwie główne kategorie: błędy po stronie serwera i błędy po stronie klienta, a także kilka problemów specyficznych dla samego procesu crawlowania.

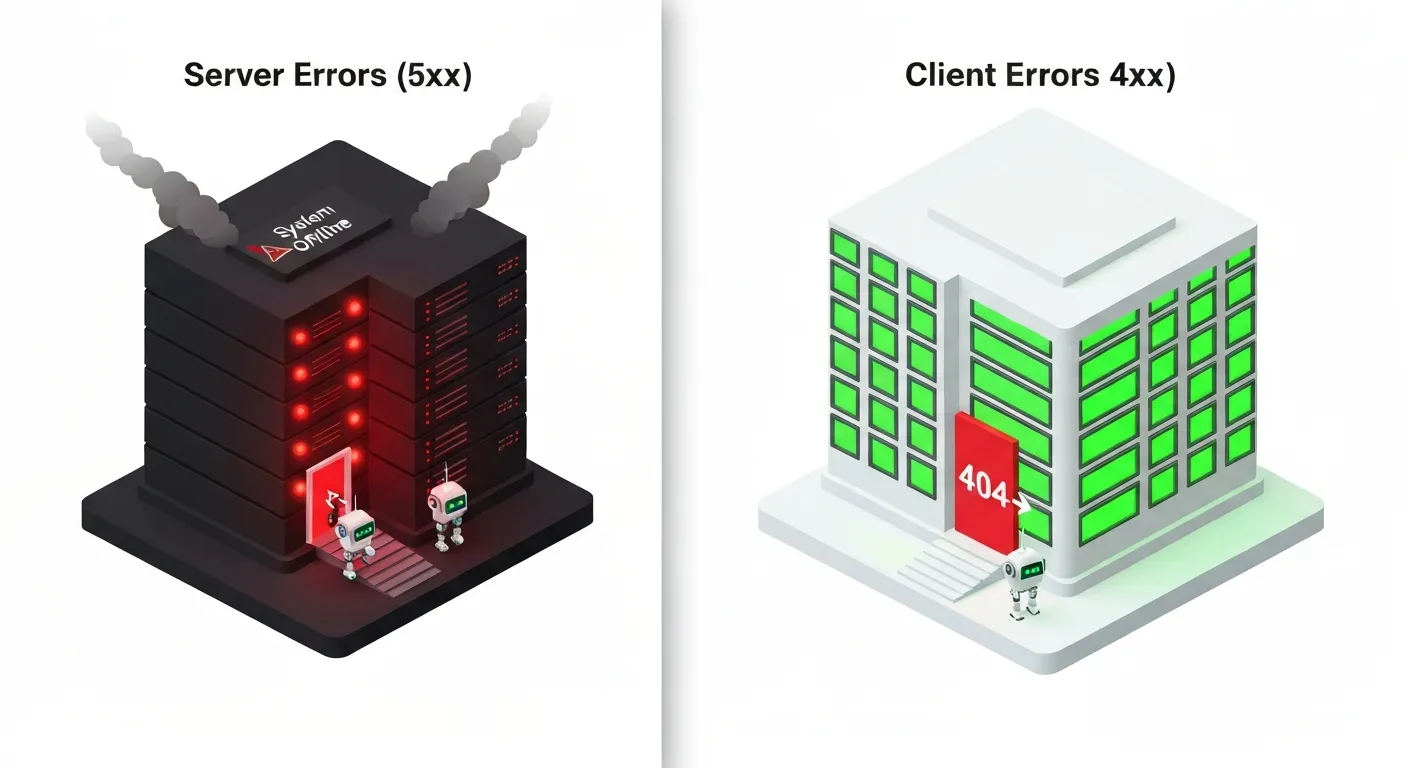

Błędy serwera (kody 5xx)

Te błędy wskazują na problem z Twoim serwerem – komputerem, na którym „mieszka” Twoja strona. Googlebot próbował uzyskać dostęp do strony, ale serwer nie był w stanie zrealizować tego żądania. To poważne błędy, ponieważ uniemożliwiają dostęp do całej witryny lub jej części.

- 500 Internal Server Error: To ogólny komunikat o błędzie, który mówi, że na serwerze wystąpił nieoczekiwany problem, ale serwer nie jest w stanie precyzyjnie określić, co poszło nie tak. Przyczyną może być błąd w skrypcie, problem z plikiem .htaccess lub błąd w oprogramowaniu serwera.

- 502 Bad Gateway: Ten błąd zazwyczaj oznacza problem w komunikacji między serwerami. Na przykład, jeśli Twój serwer działa jako pośrednik (proxy) i nie może uzyskać odpowiedzi od serwera nadrzędnego.

- 503 Service Unavailable: Najczęstsza przyczyna to przeciążenie serwera lub jego tymczasowe wyłączenie na czas konserwacji. Jeśli Twoja strona nagle zyskuje ogromną popularność i hosting nie jest w stanie obsłużyć ruchu, możesz zobaczyć ten błąd.

Błędy 5xx są krytyczne. Jeśli utrzymują się przez dłuższy czas, Google może tymczasowo, a nawet na stałe usunąć strony z indeksu, zakładając, że witryna jest trwale niedostępna.

Błędy po stronie klienta (kody 4xx)

Te błędy oznaczają, że żądanie wysłane przez klienta (w tym przypadku Googlebota) było nieprawidłowe lub nie mogło zostać zrealizowane. Problem leży po stronie żądanego adresu URL, a nie serwera jako całości.

- 404 Not Found: To najsłynniejszy i najczęstszy crawl error. Oznacza, że serwer działa poprawnie, ale nie może znaleźć zasobu pod wskazanym adresem URL. Strona mogła zostać usunięta, jej adres URL mógł zostać zmieniony, lub po prostu w linku jest literówka.

- Soft 404: To podstępny problem. Technicznie strona zwraca kod 200 OK (czyli „wszystko w porządku”), ale jej treść wskazuje, że strona nie istnieje (np. Wyświetla komunikat „Produkt niedostępny” lub jest niemal pusta). Google jest coraz lepsze w wykrywaniu takich „miękkich 404” i traktuje je jak prawdziwe błędy 404.

- 403 Forbidden: Serwer zrozumiał żądanie, ale odmawia jego autoryzacji. Oznacza to, że Googlebot nie ma uprawnień do wyświetlenia tej strony. Może to być celowe (np. Blokada dostępu dla określonych botów) lub przypadkowe (błędna konfiguracja uprawnień).

- 410 Gone: Ten kod jest podobny do 404, ale bardziej dosadny. Informuje, że zasób został trwale i celowo usunięty i nie powróci. Jest to silniejszy sygnał dla Google, aby usunąć stronę z indeksu.

Inne problemy z indeksowaniem

- Błędy DNS: Problem z systemem nazw domenowych (DNS). Oznacza, że Googlebot nie mógł przetłumaczyć nazwy Twojej domeny na adres IP serwera. To tak, jakby ktoś chciał zadzwonić, ale książka telefoniczna nie zawierała numeru. Zazwyczaj jest to problem tymczasowy lub błąd po stronie dostawcy domeny.

- Błędy pobierania pliku robots.txt: Googlebot zawsze najpierw próbuje pobrać plik /robots.txt, aby sprawdzić, które części witryny są dla niego zablokowane. Jeśli nie może uzyskać dostępu do tego pliku, wstrzymuje indeksowanie całej witryny, aby przypadkiem nie zeskanować czegoś, czego nie powinien.

Jak zlokalizować crawl error? Twoje podstawowe narzędzia

Diagnoza to pierwszy krok do wyleczenia. Na szczęście dysponujemy potężnymi i darmowymi narzędziami, które pomogą Ci znaleźć każdy crawl error Na Twojej stronie.

1. Google Search Console (GSC)

To absolutnie niezbędne narzędzie dla każdego właściciela witryny. GSC to bezpośredni kanał komunikacji z Google, który dostarcza bezcennych informacji o tym, jak wyszukiwarka widzi Twoją stronę. Aby znaleźć błędy indeksowania:

- Zaloguj się do Google Search Console i wybierz swoją witrynę.

- Przejdź do sekcji Indeksowanie > Strony W menu po lewej stronie.

- Zobaczysz wykres pokazujący strony zaindeksowane i niezaindeksowane. Poniżej znajduje się tabela z „Przyczynami, dla których strony nie są indeksowane”.

- W tej tabeli znajdziesz szczegółowe raporty dotyczące konkretnych błędów, takich jak „Nie znaleziono (404)”, „Błąd serwera (5xx)”, „Przekierowanie zawiera błąd” czy „Zablokowano z powodu niedozwolonego dostępu (403)”.

- Kliknięcie na konkretny typ błędu przeniesie Cię do listy wszystkich adresów URL, których dotyczy problem. Możesz stąd rozpocząć analizę i proces naprawczy.

Warto również regularnie zaglądać do sekcji Ustawienia > Statystyki indeksowania, Aby monitorować ogólną aktywność Googlebota, liczbę żądań i ewentualne problemy z dostępnością hosta.

2. Zewnętrzne crawlery SEO

Narzędzia takie jak Screaming Frog SEO Spider, Ahrefs Site Audit czy Semrush Site Audit działają jak Twój własny, prywatny Googlebot. Przeskanują całą Twoją witrynę, podążając za linkami, i wygenerują szczegółowe raporty o wszystkich napotkanych problemach technicznych.

Zalety korzystania z zewnętrznych crawlerów:

- Proaktywność: Możesz znaleźć błędy, zanim odkryje je Google.

- Szczegółowość: Dostarczają ogromnej ilości danych, pozwalając zlokalizować nie tylko sam błąd, ale też źródło problemu (np. Na której stronie znajduje się link prowadzący do 404).

- Kompleksowość: Analizują nie tylko kody odpowiedzi, ale też przekierowania, meta tagi, duplikację treści i wiele innych aspektów technicznego SEO.

3. Logi serwera

To opcja dla bardziej zaawansowanych użytkowników. Pliki logów serwera to szczegółowy zapis każdego pojedynczego żądania wysłanego do Twojego serwera – w tym żądań od Googlebota. Analiza logów pozwala zobaczyć, które strony są najczęściej odwiedzane przez roboty, jak często pojawiają się błędy i czy nie ma problemów z budżetem indeksowania. To najbardziej surowe i precyzyjne źródło danych o aktywności crawlerów na Twojej stronie.

Krok po kroku: Skuteczne naprawianie najczęstszych błędów indeksowania

Zidentyfikowanie problemu to połowa sukcesu. Teraz czas na działanie. Poniżej znajdziesz praktyczne instrukcje, jak radzić sobie z najpopularniejszymi typami błędów.

Naprawianie błędów 404 („Nie znaleziono”)

Gdy znajdziesz listę adresów URL z błędem 404, dla każdego z nich musisz podjąć decyzję. Masz kilka opcji:

- Przekierowanie 301 (trwałe): To najlepsze rozwiązanie w 90% przypadków. Jeśli strona została przeniesiona pod nowy adres lub istnieje inna, bardzo podobna tematycznie strona, ustaw przekierowanie 301. Dzięki temu zarówno użytkownicy, jak i roboty zostaną automatycznie przeniesieni na właściwy adres, a co najważniejsze, zostanie przekazana większość „mocy SEO” (link juice) ze starego adresu na nowy.

- Naprawienie linku źródłowego: Jeśli błąd 404 jest spowodowany literówką w linku wewnętrznym na Twojej własnej stronie (np. W menu, w artykule), najprostszym rozwiązaniem jest edycja tej strony i poprawienie błędnego linku.

- Świadome pozostawienie 404: Jeśli strona została usunięta, nie ma swojego odpowiednika, a dodatkowo nie prowadzą do niej żadne wartościowe linki zewnętrzne, możesz pozostawić kod 404. Google w końcu usunie ją z indeksu. To prawidłowy sygnał dla stron, które naprawdę nie istnieją.

- Użycie kodu 410 („Zniknęła”): Jeśli chcesz przyspieszyć proces usuwania strony z indeksu, bo masz pewność, że została usunięta na stałe, możesz zamiast 404 ustawić kod odpowiedzi 410.

Ważna rada: Zawsze twórz spersonalizowaną stronę błędu 404. Powinna ona zawierać logo Twojej firmy, przyjazny komunikat oraz użyteczne linki (np. Do strony głównej, mapy witryny, popularnych kategorii), aby zatrzymać użytkownika w witrynie.

Naprawianie błędów serwera (5xx)

Te błędy są z natury bardziej techniczne i często wymagają interwencji dewelopera lub administratora hostingu. Twoje działania powinny wyglądać następująco:

- Sprawdź, czy problem jest stały: Użyj narzędzia do sprawdzania nagłówków HTTP, aby zobaczyć, czy błąd nadal występuje. Czasem są to chwilowe problemy.

- Skontaktuj się z dostawcą hostingu: To pierwszy i najważniejszy krok. Poinformuj ich o błędach 5xx. Mogą oni sprawdzić logi serwera, obciążenie, status usług i zdiagnozować problem po swojej stronie.

- Przeanalizuj ostatnie zmiany: Czy ostatnio instalowałeś nowe wtyczki, aktualizowałeś system CMS lub wprowadzałeś zmiany w kodzie? Często błędy 500 są wynikiem wadliwego kodu w nowym rozszerzeniu lub motywie.

- Sprawdź plik .htaccess: Nieprawidłowa składnia w tym pliku konfiguracyjnym jest częstą przyczyną błędów 500.

Rozwiązywanie problemów z plikiem robots.txt

Jeśli GSC zgłasza, że ważne strony są blokowane przez plik robots.txt, musisz go edytować. Użyj Testera pliku robots.txt w Google Search Console (znajdziesz go w starszej wersji narzędzi), aby sprawdzić, czy dyrektywy `Disallow:` nie blokują dostępu do kluczowych zasobów, takich jak pliki CSS, JavaScript czy całe sekcje serwisu, które powinny być indeksowane.

Prewencja jest lepsza niż leczenie: Jak unikać crawl errors w przyszłości?

Naprawianie błędów jest ważne, ale jeszcze ważniejsze jest zapobieganie ich powstawaniu. Wprowadź poniższe praktyki do swojej regularnej rutyny SEO, aby utrzymać witrynę w nienagannym stanie technicznym.

- Regularne audyty techniczne: Przynajmniej raz w miesiącu przeprowadzaj pełne skanowanie swojej witryny za pomocą narzędzi takich jak Screaming Frog. Ustaw sobie przypomnienie w kalendarzu.

- Cotygodniowy przegląd Google Search Console: Poświęć 15 minut w każdy poniedziałek na sprawdzenie raportu „Strony” w GSC. Wczesne wykrycie gwałtownego wzrostu błędów pozwoli Ci szybko zareagować.

- Utrzymywanie higieny mapy witryny (sitemap.xml): Twoja mapa witryny powinna zawierać tylko kanoniczne, działające adresy URL, które zwracają kod 200 OK. Regularnie usuwaj z niej strony, które generują błędy lub zostały przekierowane.

- Wdrożenie procedury zmiany adresów URL: Zanim usuniesz stronę lub zmienisz jej adres URL, zawsze miej przygotowany plan przekierowań 301. Nigdy nie usuwaj stron „po cichu”.

- Inwestycja w solidny hosting: Tani hosting często oznacza współdzielone zasoby i większą podatność na przeciążenia, co prowadzi do błędów 5xx. Inwestycja w niezawodnego dostawcę hostingu to fundament zdrowej witryny.

Zakończenie

Crawl error To nie tylko techniczny żargon dla specjalistów. To fundamentalny wskaźnik zdrowia i dostępności Twojej witryny dla wyszukiwarek i użytkowników. Ignorowanie tych błędów jest jak budowanie pięknego sklepu z zamkniętymi na cztery spusty drzwiami – nikt nie wejdzie do środka, bez względu na to, jak wspaniałe produkty oferujesz. Regularne monitorowanie, szybka diagnoza i skuteczne naprawianie błędów indeksowania to kluczowe elementy strategii SEO, które zapewniają, że Twoje treści mają szansę dotrzeć do odbiorców i osiągnąć wysokie pozycje w wynikach wyszukiwania. Nie pozwól, aby proste do naprawienia błędy techniczne stały na drodze do Twojego sukcesu. Otwórz Google Search Console i rozpocznij audyt swojej witryny już dziś.

Dodaj komentarz