Robots.txt: kompletny przewodnik po pliku sterującym robotami Google

W skomplikowanym ekosystemie cyfrowym, gdzie roboty wyszukiwarek nieustannie przeczesują miliardy stron, istnieje mały, ale niezwykle potężny plik tekstowy, który działa jak cichy strażnik Twojej witryny. Nazywa się robots.txt I jest jednym z fundamentalnych elementów technicznego SEO. Dla wielu marketingowców i właścicieli stron jego istnienie jest tajemnicą, a konfiguracja wydaje się czarną magią. Nic bardziej mylnego. Zrozumienie i prawidłowe wykorzystanie pliku robots.txt to nie opcja, a konieczność dla każdego, kto poważnie myśli o widoczności w Google.

Wyobraź sobie, że Twoja strona internetowa to ogromna biblioteka. Roboty Google (tzw. Crawlery lub pająki) są jak niezwykle sumienni bibliotekarze, którzy chcą przeczytać i skatalogować każdą książkę. Plik robots.txt to nic innego jak instrukcja, którą zostawiasz dla tych bibliotekarzy przy wejściu. Mówi im: „Możecie wchodzić do wszystkich głównych sal, ale proszę, nie wchodźcie do zaplecza, archiwum z wersjami roboczymi i prywatnego biura”. Dzięki temu oszczędzasz ich czas i energię, a oni skupiają się na tym, co najważniejsze – na treściach, które chcesz pokazać światu. W tym kompletnym przewodniku przeprowadzimy Cię przez wszystkie aspekty pliku robots.txt, od jego podstawowej struktury, przez kluczowe dyrektywy, aż po najczęstsze błędy i metody testowania. Czas przejąć kontrolę nad tym, jak roboty widzą Twoją stronę.

Czym jest plik robots.txt i dlaczego jest tak ważny dla SEO?

Plik robots.txt To prosty plik tekstowy umieszczony w głównym katalogu (root) Twojej domeny. Jego formalna nazwa to „Robots Exclusion Protocol” (Protokół Wykluczania Robotów). Jego jedynym celem jest komunikacja z robotami internetowymi, takimi jak Googlebot, Bingbot i innymi, informując je, do których części Twojej witryny mają zakaz dostępu.

Warto od razu podkreślić: dyrektywy w pliku robots.txt są prośbą, a nie żelaznym prawem. Renomowane roboty, takie jak te od Google czy Bing, zawsze stosują się do tych zaleceń. Jednak złośliwe boty, np. Te zbierające adresy e-mail, mogą go całkowicie zignorować. Dlatego nigdy nie należy używać robots.txt do ukrywania naprawdę poufnych informacji.

Jego rola w strategii SEO jest jednak nie do przecenienia z kilku kluczowych powodów:

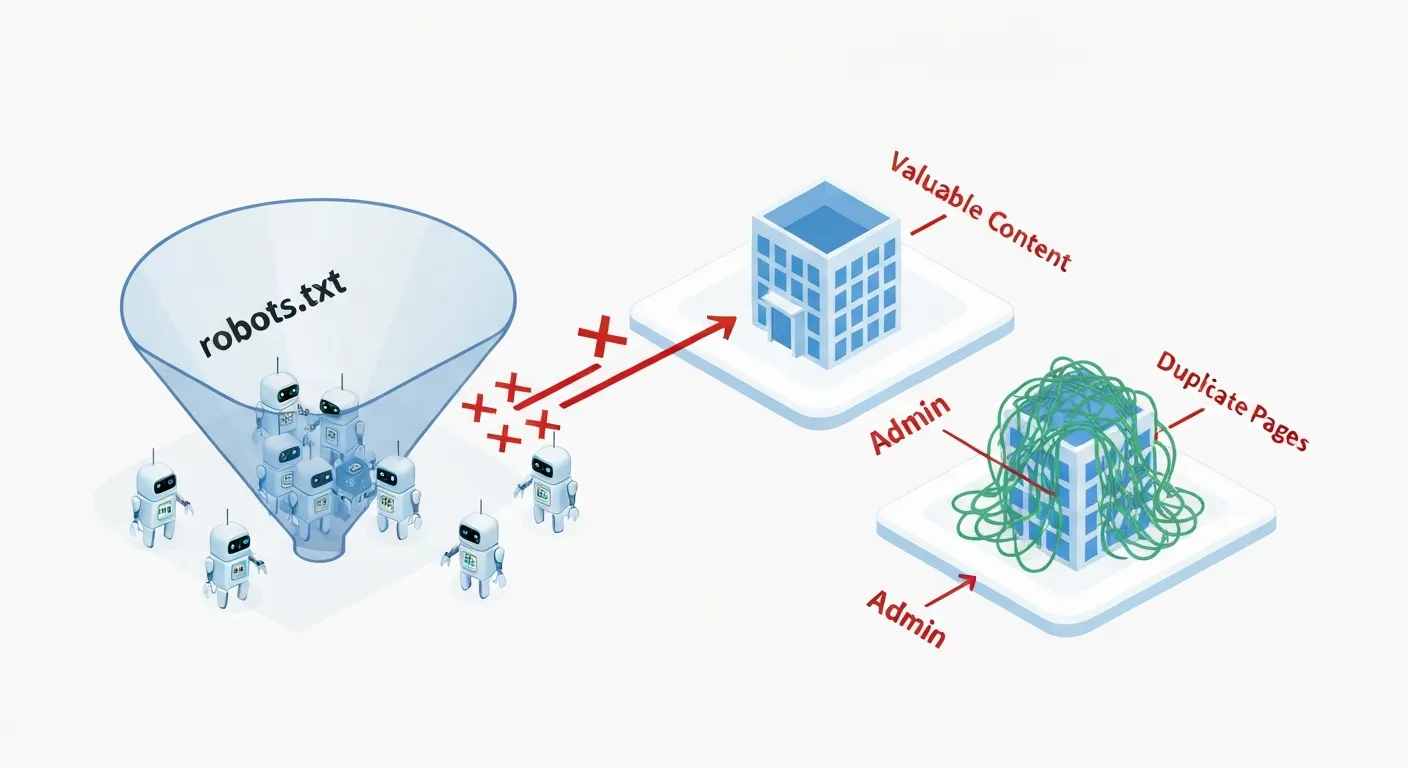

- Zarządzanie budżetem indeksowania (Crawl Budget). Google przydziela każdej witrynie ograniczony „budżet” na indeksowanie – czyli określoną ilość zasobów i czasu, które jego roboty mogą poświęcić na przejrzenie Twoich podstron. Jeśli masz ogromny serwis z tysiącami URL-i, z których wiele jest niskiej jakości (np. Strony wyników wyszukiwania wewnętrznego, strony z filtrami, wersje do druku), roboty mogą marnować swój cenny czas na ich analizowanie. Blokując dostęp do tych nieistotnych sekcji za pomocą robots.txt, kierujesz uwagę Googlebota na najważniejsze strony – te, które faktycznie mają generować ruch i konwersje.

- Zapobieganie indeksowaniu zduplikowanej treści. Duplikacja treści to jeden z poważniejszych problemów SEO. Często jest generowana nieświadomie przez system CMS. Przykłady to URL-e z parametrami sesji, strony sortowania produktów (np. Według ceny, popularności), czy wspomniane wersje do druku. Blokując te warianty URL-i, dajesz Google jasny sygnał, która wersja strony jest tą kanoniczną i jedyną, która powinna znaleźć się w indeksie.

- Ochrona zasobów prywatnych i technicznych. Każda witryna posiada obszary, które nie powinny być dostępne publicznie. Mogą to być panele administracyjne, katalogi z plikami tymczasowymi, strony z podziękowaniem po zakupie, czy wewnętrzne pliki PDF. Plik robots.txt jest pierwszą linią obrony przed ich przypadkowym zaindeksowaniem.

- Kontrola dostępu dla różnych botów. Możesz tworzyć oddzielne reguły dla różnych robotów. Na przykład, możesz pozwolić Googlebotowi na indeksowanie wszystkiego, ale zablokować dostęp dla mniej znanych crawlerów, które mogą nadmiernie obciążać Twój serwer.

Jak wygląda i gdzie znaleźć plik robots.txt?

Struktura pliku robots.txt jest niezwykle prosta i opiera się na zestawie reguł. Każda reguła składa się z dwóch głównych części: określenia, do którego robota się zwracamy (User-agent) oraz dyrektywy, co ten robot ma zrobić (np. Disallow).

Lokalizacja pliku

To absolutnie kluczowe: plik robots.txt Musi znajdować się w głównym katalogu domeny. Oznacza to, że musi być dostępny pod adresem `https://www.twojadomena.pl/robots.txt`. Umieszczenie go w jakimkolwiek innym podkatalogu (np. `/blog/robots.txt`) sprawi, że roboty go nie znajdą i zignorują.

Podstawowa składnia

Plik składa się z co najmniej jednej grupy reguł. Każda grupa zaczyna się od dyrektywy `User-agent`.

- User-agent: Ta linia określa, do którego robota (crawlera) odnosi się poniższa reguła. Można podać konkretną nazwę, np. `Googlebot`, `Bingbot`, lub użyć gwiazdki (`*`), która jest symbolem wieloznacznym oznaczającym „wszystkie roboty”.

- Disallow: Ta dyrektywa informuje robota, których ścieżek URL nie powinien odwiedzać. Jeśli linia `Disallow:` jest pusta, oznacza to, że robot może odwiedzać wszystko. Jeśli zawiera ukośnik (`/`), oznacza to zablokowanie całej witryny.

- Allow: To dyrektywa, która działa jako wyjątek od reguły `Disallow`. Pozwala na dostęp do określonego pliku lub podkatalogu, nawet jeśli jego nadrzędny katalog jest zablokowany.

- Sitemap: Chociaż nie jest to dyrektywa sterująca dostępem, jest to niezwykle ważny i zalecany wpis. Wskazuje robotom lokalizację Twojej mapy witryny (sitemap.xml), co ułatwia im odnalezienie wszystkich ważnych URL-i do zaindeksowania.

Oto przykład bardzo prostego, ale w pełni funkcjonalnego pliku robots.txt:

User-agent: *

Disallow: /wp-admin/

Disallow: /prywatne-pliki/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://www.twojadomena.pl/sitemap.xml

W powyższym przykładzie:

- `User-agent: *` – reguła dotyczy wszystkich robotów.

- `Disallow: /wp-admin/` – blokujemy dostęp do katalogu administracyjnego WordPressa.

- `Disallow: /prywatne-pliki/` – blokujemy dostęp do katalogu z prywatnymi plikami.

- `Allow: /wp-admin/admin-ajax.php` – robimy wyjątek, pozwalając na dostęp do kluczowego dla działania niektórych motywów pliku, mimo że cały katalog `/wp-admin/` jest zablokowany.

- `Sitemap: …` – wskazujemy robotom, gdzie znajduje się nasza mapa witryny.

Kluczowe dyrektywy i ich praktyczne zastosowanie

Aby w pełni wykorzystać potencjał pliku robots.txt, Musisz dobrze zrozumieć jego dyrektywy i sposób ich interpretacji przez roboty. Diabeł, jak zwykle, tkwi w szczegółach.

Szczegółowe omówienie `User-agent`

Możesz tworzyć wiele bloków reguł dla różnych robotów. Roboty zawsze będą szukać najbardziej szczegółowej reguły pasującej do ich nazwy. Jeśli jej nie znajdą, zastosują się do reguły ogólnej (`User-agent: *`).

Przykład: Chcesz zablokować dostęp do pewnego katalogu wszystkim botom, ale pozwolić na to Googlebotowi.

User-agent: Googlebot

Disallow:

User-agent: *

Disallow: /dane-do-analizy/

W tym przypadku Googlebot zignoruje drugą regułę, ponieważ znalazł pierwszą, dedykowaną specjalnie dla niego (z pustym `Disallow`, co oznacza „możesz wchodzić wszędzie”). Wszystkie inne boty zastosują się do drugiej reguły i nie wejdą do katalogu `/dane-do-analizy/`.

Zaawansowane użycie `Disallow` i `Allow` z symbolami wieloznacznymi

Standard robots.txt obsługuje dwa główne symbole wieloznaczne, które znacznie zwiększają jego elastyczność:

- `*` (Gwiazdka) – zastępuje dowolny ciąg znaków.

- `$` (Dolar) – oznacza koniec adresu URL.

Przykład 1: Blokowanie wszystkich plików PDF

Jeśli chcesz uniemożliwić robotom indeksowanie wszystkich plików PDF na Twojej stronie, możesz użyć następującej reguły:

User-agent: *

Disallow: /*.pdf$

Dzięki znakowi `$` na końcu, ta reguła zablokuje URL-e takie jak `https://example.com/raport.pdf`, ale nie zablokuje `https://example.com/strona-o-pdf-ach`. Znak `*` dopasuje każdą nazwę pliku.

Przykład 2: Blokowanie URL-i z określonym parametrem

Sklepy internetowe często generują setki wariantów URL-i przez parametry sortowania, filtrowania itp. Możemy je skutecznie zablokować.

User-agent: *

Disallow: /*?sort=

Disallow: /*&filter=

Ta reguła zablokuje każdy URL zawierający `?sort=` lub `&filter=`, co znacząco pomaga w zarządzaniu budżetem indeksowania i unikaniu duplikacji treści.

Przykład 3: Logika `Allow` i `Disallow`

Pamiętaj, że roboty (szczególnie Googlebot) biorą pod uwagę długość pasującej ścieżki. Dłuższa, bardziej szczegółowa reguła ma pierwszeństwo.

Rozważmy taki plik:

User-agent: *

Disallow: /media/

Allow: /media/zdjecia-publiczne/

W tym przypadku, mimo że cały katalog `/media/` jest zablokowany, roboty będą mogły wejść do podkatalogu `/media/zdjecia-publiczne/`, ponieważ reguła `Allow` jest bardziej szczegółowa (ma dłuższą ścieżkę).

Najczęstsze błędy w pliku robots.txt i jak ich unikać

Nieprawidłowo skonfigurowany plik robots.txt Może przynieść więcej szkody niż pożytku, prowadząc do poważnych problemów z widocznością strony. Oto lista najczęstszych pułapek, na które należy uważać.

Błąd 1: Przypadkowe zablokowanie całej witryny

To błąd katastrofalny, ale zdarza się zaskakująco często. Wystarczy jedna linijka:

User-agent: *

Disallow: /

Taka konfiguracja mówi wszystkim robotom, aby nie indeksowały absolutnie niczego na Twojej stronie. W ciągu kilku dni Twoja witryna może całkowicie zniknąć z wyników wyszukiwania. Zawsze upewnij się, że dyrektywa `Disallow: /` jest używana świadomie, np. Na stronach deweloperskich, które nie mają być jeszcze publicznie dostępne.

Błąd 2: Blokowanie zasobów CSS i JavaScript

W przeszłości była to powszechna praktyka, aby „oszczędzać” budżet indeksowania. Dziś jest to ogromny błąd. Googlebot musi mieć dostęp do plików CSS i JS, aby poprawnie wyrenderować stronę i zrozumieć jej zawartość oraz układ. Zablokowanie tych zasobów może sprawić, że Google „zobaczy” Twoją stronę jako pustą lub źle sformatowaną, co negatywnie wpłynie na jej ocenę i ranking.

Nigdy nie dodawaj takich reguł:

Disallow: /css/

Disallow: /js/

Błąd 3: Używanie robots.txt do deindeksacji treści (zamiast noindex)

To jedno z największych nieporozumień dotyczących robots.txt. `Disallow` w robots.txt nie usuwa strony z indeksu Google. Mówi jedynie robotowi, aby jej nie odwiedzał. Jeśli dana strona ma już linki przychodzące z innych miejsc w internecie, Google może ją nadal zaindeksować, nawet jej nie odwiedzając. W wynikach wyszukiwania pojawi się ona wtedy z komunikatem „Opis jest niedostępny z powodu pliku robots.txt tej witryny.”.

Jeśli chcesz, aby dana strona została usunięta z indeksu lub nigdy do niego nie trafiła, musisz użyć metatagu `noindex` w sekcji „ Tej strony (``) Lub nagłówka HTTP X-Robots-Tag. To daje Google jasny i jednoznaczny sygnał, aby nie uwzględniać tej strony w swoich wynikach.

Błąd 4: Błędy składni (literówki, wielkość liter)

Składnia pliku robots.txt jest prosta, ale i bezlitosna dla błędów. Literówka w `User-agent` lub `Disallow` sprawi, że cała reguła zostanie zignorowana. Co więcej, ścieżki w dyrektywach są wrażliwe na wielkość liter. Oznacza to, że `Disallow: /Folder/` nie jest tym samym co `Disallow: /folder/`. Zawsze trzymaj się konsekwentnego nazewnictwa i dokładnie sprawdzaj każdą linijkę.

Jak przetestować swój plik robots.txt?

Zanim wgrasz nową wersję pliku robots.txt na serwer produkcyjny, absolutnie konieczne jest jego przetestowanie. Ryzyko popełnienia błędu, który zaszkodzi Twojemu SEO, jest zbyt duże, by działać na ślepo. Na szczęście Google dostarcza doskonałe narzędzie, które to ułatwia.

Tester pliku robots.txt w Google Search Console

Narzędzie to jest częścią pakietu Google Search Console (GSC). Pozwala ono na zweryfikowanie, czy Twój plik jest poprawny składniowo oraz na przetestowanie, czy konkretne adresy URL są blokowane dla różnych robotów Google.

Jak z niego skorzystać?

- Zaloguj się do swojego konta Google Search Console.

- Wybierz odpowiednią usługę (swoją stronę internetową).

- W menu nawigacyjnym na dole znajdź sekcję „Starsze narzędzia i raporty”, a w niej „Tester pliku robots.txt”.

- Narzędzie automatycznie pobierze aktualną wersję pliku z Twojego serwera. Zobaczysz jego zawartość wraz z ewentualnymi błędami składniowymi lub ostrzeżeniami.

- Możesz edytować kod bezpośrednio w oknie testera, aby sprawdzić „na sucho” działanie nowych reguł, bez modyfikacji pliku na serwerze.

- Poniżej edytora znajduje się pole, w które możesz wpisać dowolny adres URL z Twojej witryny. Następnie wybierz z listy rozwijanej User-agenta (np. Googlebot, Googlebot-Image) i kliknij „TESTUJ”.

- Narzędzie natychmiast poinformuje Cię, czy dla danego robota ten URL jest „Dozwolony” czy „Zablokowany”, wskazując jednocześnie, która linijka w pliku robots.txt jest za to odpowiedzialna.

Regularne korzystanie z tego testera, zwłaszcza przy wprowadzaniu zmian, to najlepszy sposób na uniknięcie kosztownych pomyłek. Pozwala ono zyskać pewność, że blokujesz dokładnie to, co chcesz zablokować, i nic ponadto.

Zakończenie: Mały plik o wielkim znaczeniu

Plik robots.txt, Mimo swojej prostej, tekstowej formy, jest jednym z najpotężniejszych narzędzi w arsenale specjalisty SEO i świadomego marketera. To on decyduje o tym, jak roboty wyszukiwarek poruszają się po Twojej witrynie, gdzie koncentrują swoją uwagę i które jej części ignorują. Prawidłowo skonfigurowany, staje się kluczem do optymalizacji budżetu indeksowania, eliminacji problemów z duplikacją treści i ochrony wrażliwych obszarów serwisu.

Pamiętaj jednak o jego ograniczeniach – jest to protokół oparty na dobrowolności i nie służy do zabezpieczania danych ani do usuwania stron z indeksu. Do tych celów istnieją inne, dedykowane mechanizmy. Traktuj robots.txt jak uprzejmego, ale stanowczego kierownika ruchu dla botów – wskazującego im drogę, ale nie stawiającego fizycznych barier. Poświęć czas na analizę, konfigurację i testowanie swojego pliku. To niewielka inwestycja, która może przynieść ogromne korzyści w postaci lepszej widoczności i zdrowszej struktury technicznej Twojej witryny w oczach Google.

Zobacz więcej:

- Optymalizacja budżetu kampanii (CBO): Kompletny przewodnik po efektywnym zarządzaniu wydatkami

- Co to jest struktura adresu URL i jak wpływa na pozycjonowanie?

- Co to jest FAQ i jak stworzyć skuteczną sekcję z odpowiedziami?

- WhatsApp Business: Jak wykorzystać jego potencjał w komunikacji z klientami?

- Tagowanie w marketingu: Klucz do precyzyjnej analizy danych

Dodaj komentarz