Meta robots: kompleksowy przewodnik po dyrektywach dla wyszukiwarek

W świecie cyfrowego marketingu i SEO, kontrola nad tym, jak wyszukiwarki internetowe, takie jak Google, widzą i indeksują naszą stronę, jest absolutnie kluczowa. To nie jest kwestia przypadku, lecz świadomej strategii. Jednym z najpotężniejszych, a jednocześnie często niedocenianych narzędzi w arsenale każdego specjalisty SEO jest meta tag robots. To właśnie ten niewielki fragment kodu decyduje, które drzwi naszej witryny otwieramy dla robotów indeksujących, a które pozostawiamy zamknięte. Błędna konfiguracja może prowadzić do zniknięcia kluczowych podstron z wyników wyszukiwania, podczas gdy świadome i precyzyjne zarządzanie dyrektywami może znacząco poprawić widoczność, zarządzać budżetem indeksowania i chronić wrażliwe treści.

Wielu twórców stron internetowych i marketerów ogranicza swoją wiedzę do podstawowych komend „index” i „noindex”. Jednakże, świat dyrektyw meta robots Jest znacznie bogatszy i oferuje granularną kontrolę, która może stać się przewagą konkurencyjną. Czy wiesz, jak zapobiec wyświetlaniu fragmentu tekstu (snippetu) w wynikach wyszukiwania? Jak zasugerować Google, aby nie indeksowało obrazków na danej stronie? Albo jak automatycznie usunąć stronę z indeksu po określonej dacie? Ten kompleksowy przewodnik przeprowadzi Cię przez wszystkie aspekty tagu meta robots – od absolutnych podstaw, przez zaawansowane dyrektywy, aż po najczęstsze błędy i najlepsze praktyki. Po lekturze tego artykułu będziesz w stanie z pełną świadomością zarządzać komunikacją swojej witryny z wyszukiwarkami, optymalizując jej potencjał SEO.

Czym jest meta tag robots i dlaczego jest tak ważny w seo?

Meta tag robots to fragment kodu HTML umieszczany w sekcji <head> Strony internetowej. Jego jedynym celem jest przekazanie konkretnych instrukcji (dyrektyw) robotom wyszukiwarek (nazywanym również crawlerami lub pająkami), które odwiedzają i analizują zawartość witryny. W najprostszej formie wygląda on następująco:

<meta name="robots" content="index, follow">

Przeanalizujmy jego dwa kluczowe atrybuty:

- name=”robots”: Ten atrybut określa, do którego robota kierowana jest instrukcja. Wartość „robots” jest uniwersalna i dotyczy wszystkich wyszukiwarek. Możemy jednak kierować dyrektywy do konkretnych botów, na przykład „googlebot” (dla Google), „bingbot” (dla Bing) czy „duckduckbot” (dla DuckDuckGo).

- content=”…”: To serce całego tagu. W tym atrybucie umieszczamy jedną lub więcej dyrektyw, oddzielonych przecinkami, które mówią robotowi, co ma zrobić z daną stroną i zawartymi na niej linkami.

Dlaczego jest to tak fundamentalne dla SEO? Znaczenie tagu meta robots Wykracza daleko poza prostą decyzję o indeksowaniu. Jego strategiczne wykorzystanie wpływa na kilka kluczowych obszarów optymalizacji:

- Zarządzanie budżetem indeksowania (Crawl Budget): Każda witryna ma przydzielony przez Google „budżet” na indeksowanie, czyli ograniczoną ilość zasobów, jakie roboty poświęcą na jej skanowanie. Blokując indeksowanie stron o niskiej wartości (np. Strony z wynikami wewnętrznego wyszukiwania, archiwa tagów, panele logowania, strony „dziękuję za zakup”), kierujemy cenne zasoby crawlerów na najważniejsze podstrony – te, które mają generować ruch i konwersje.

- Zapobieganie kanibalizacji i duplikacji treści: W obrębie jednej witryny często istnieją strony o bardzo podobnej lub identycznej treści, dostępne pod różnymi adresami URL (np. Wersje do druku, strony z parametrami sortowania). Taka sytuacja może zdezorientować wyszukiwarki i prowadzić do rozproszenia „mocy” SEO. Użycie dyrektywy „noindex” na zduplikowanych wersjach, w połączeniu z tagiem kanonicznym, jest podstawową techniką higieny SEO.

- Ochrona treści na wczesnym etapie: Podczas budowy nowej strony lub wprowadzania dużych zmian, często korzysta się z serwerów deweloperskich (staging). Użycie globalnej dyrektywy „noindex” na takiej wersji serwisu zapobiega przypadkowemu zaindeksowaniu niedokończonych lub testowych treści, co mogłoby zaszkodzić reputacji domeny.

- Kontrola nad wyglądem w wynikach wyszukiwania (SERP): Jak zobaczymy w dalszej części, zaawansowane dyrektywy pozwalają kontrolować, czy Google ma pokazywać fragment opisu pod linkiem, jakiej wielkości miniatury obrazków może użyć, czy ma oferować tłumaczenie strony.

W skrócie, meta robots To nie jest opcjonalny dodatek, ale niezbędne narzędzie do precyzyjnego rzeźbienia obecności witryny w ekosystemie wyszukiwarek. Ignorowanie go jest jak pozostawienie otwartych drzwi do wszystkich pomieszczeń w domu, również tych prywatnych i gospodarczych.

Podstawowe dyrektywy meta robots, które musisz znać

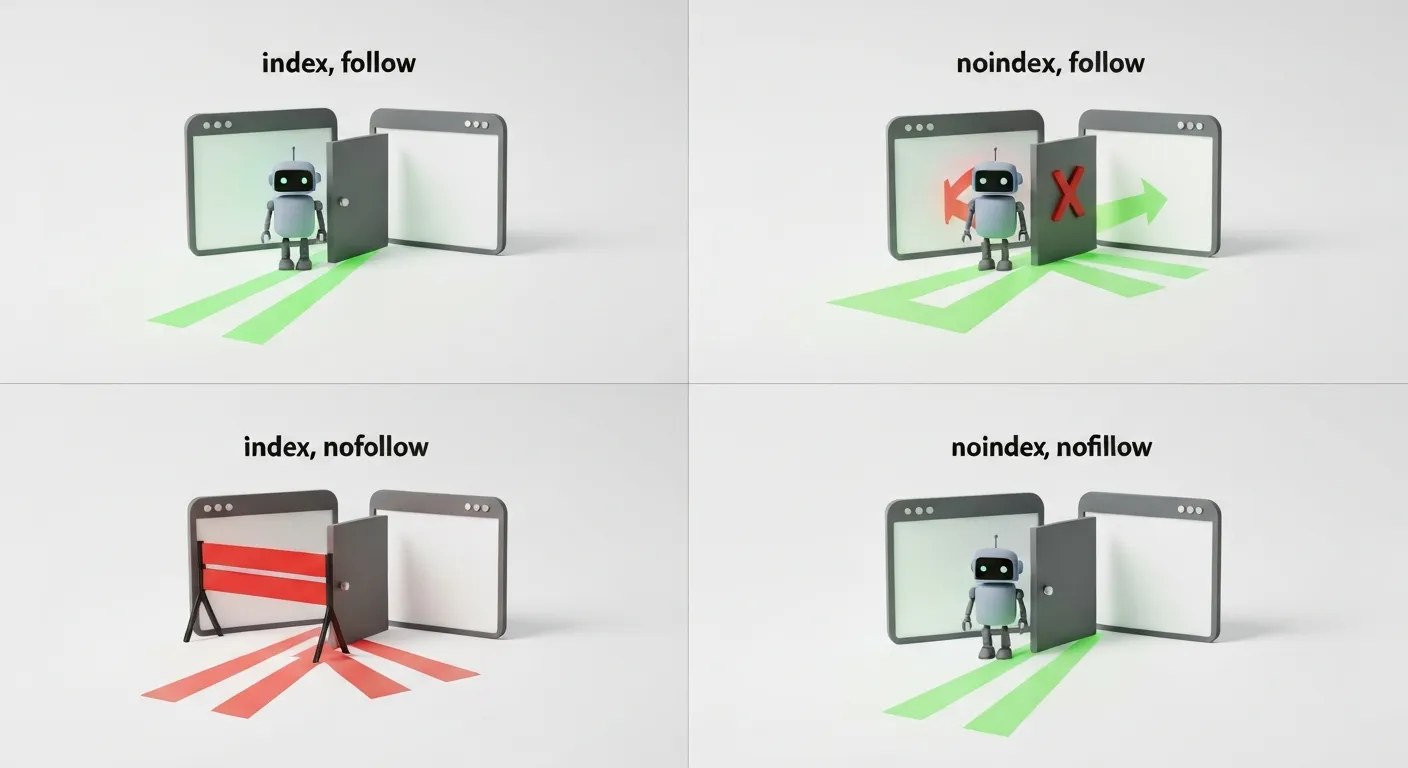

Zanim przejdziemy do bardziej zaawansowanych zastosowań, absolutnie kluczowe jest zrozumienie czterech fundamentalnych dyrektyw, które stanowią podstawę komunikacji z robotami. To one są wykorzystywane w 99% przypadków i każdy, kto zarządza stroną internetową, powinien je znać.

Index

To dyrektywa domyślna, która informuje wyszukiwarki: „Proszę, dodaj tę stronę do swojego indeksu, aby mogła być wyświetlana w wynikach wyszukiwania”. Jeśli na stronie nie ma żadnego tagu meta robots, wyszukiwarki traktują ją tak, jakby miała dyrektywę index. Chociaż jej jawne dodawanie nie jest konieczne, czasem stosuje się ją dla pewności, np. Po usunięciu tagu noindex, Aby dać jasny sygnał, że strona jest gotowa do ponownego zaindeksowania.

Przykład: <meta name="robots" content="index">

Noindex

To najważniejsza i najpotężniejsza dyrektywa. Jest to wyraźne polecenie dla wyszukiwarek: „Nie dodawaj tej strony do swojego indeksu”. Jeśli strona już znajduje się w indeksie, po napotkaniu tego tagu zostanie z niego usunięta przy następnej wizycie robota. Jest to niezwykle użyteczne w przypadku:

- Stron z podziękowaniem za złożenie zamówienia lub zapis do newslettera.

- Wewnętrznych wyników wyszukiwania w serwisie.

- Stron logowania, rejestracji i paneli administracyjnych.

- Treści o niskiej jakości lub „cienkich” (thin content), które nie wnoszą wartości dla użytkownika z perspektywy wyszukiwarki.

- Stron w budowie lub na serwerze testowym.

Przykład: <meta name="robots" content="noindex">

Follow

Podobnie jak index, Jest to dyrektywa domyślna. Mówi ona robotom: „Możesz śledzić wszystkie linki znajdujące się na tej stronie i przekazywać im część autorytetu (tzw. Link juice)„. Nawet jeśli strona ma dyrektywę noindex, Roboty wciąż mogą podążać za linkami, jeśli towarzyszy jej dyrektywa follow. Jest to bardzo częsta i użyteczna kombinacja.

Przykład: <meta name="robots" content="follow">

Nofollow

To polecenie instruuje wyszukiwarki, aby nie podążały za żadnymi linkami na danej stronie i nie przekazywały im autorytetu. Używa się jej rzadziej na poziomie całej strony. Częściej stosuje się atrybut rel="nofollow" Dla pojedynczych linków, np. W komentarzach na blogu lub przy linkach sponsorowanych. Użycie nofollow W meta tagu robots może być przydatne na stronach, które agregują dużą ilość linków do zewnętrznych, niezweryfikowanych źródeł.

Przykład: <meta name="robots" content="nofollow">

Najważniejsze kombinacje:

noindex, follow: Najpopularniejsza kombinacja po domyślnej. Mówi: „Nie pokazuj tej strony w wynikach wyszukiwania, ale przeanalizuj linki, które się na niej znajdują i przekaż im moc”. Idealne dla stron archiwalnych (np. Archiwum tagów na blogu), które grupują linki do wartościowych artykułów.index, nofollow: Mniej popularna kombinacja. Mówi: „Zaindeksuj tę stronę, ale zignoruj wszystkie linki, które na niej umieściłem”. Może być użyteczna, ale wymaga ostrożności, aby nie blokować przepływu mocy do własnych, ważnych podstron.noindex, nofollow: Najbardziej restrykcyjna kombinacja. Mówi: „Zignoruj tę stronę całkowicie – nie indeksuj jej i nie podążaj za żadnymi linkami”. Często używana dla paneli logowania czy stron w głębokiej fazie deweloperskiej.

Istnieją również skróty: all Jest równoznaczne z index, follow, A none Jest równoznaczne z noindex, nofollow.

Zaawansowane i mniej znane dyrektywy meta robots

Świat dyrektyw meta robots Nie kończy się na czterech podstawowych poleceniach. Istnieje szereg dodatkowych instrukcji, które pozwalają na jeszcze bardziej precyzyjną kontrolę nad tym, jak nasza treść jest przetwarzana i prezentowana przez Google. Znajomość tych dyrektyw może być kluczowa w niszowych strategiach SEO i content marketingu.

Nosnippet

Ta dyrektywa zabrania wyszukiwarkom wyświetlania jakiegokolwiek fragmentu tekstu (tzw. Snippetu) lub podglądu wideo pod linkiem do naszej strony w wynikach wyszukiwania. W efekcie użytkownik zobaczy tylko tytuł strony i jej adres URL. Może to być przydatne, gdy chcemy zmusić użytkownika do kliknięcia, aby poznać zawartość, np. W przypadku stron z wynikami sportowymi, notowaniami giełdowymi czy krótkimi definicjami, gdzie sam snippet mógłby zaspokoić jego ciekawość.

Przykład: <meta name="robots" content="nosnippet">

Max-snippet:[liczba]

To bardziej elastyczna alternatywa dla nosnippet. Pozwala określić maksymalną długość snippetu w znakach. Jeśli ustawimy wartość 0, będzie to działać tak samo jak nosnippet. Wartość -1 oznacza brak ograniczeń. Można jej użyć, aby stworzyć bardzo krótkie, intrygujące zajawki, które zachęcą do kliknięcia.

Przykład: <meta name="robots" content="max-snippet:60"> (Wyświetli maksymalnie 60 znaków)

Max-image-preview:[ustawienie]

Ta dyrektywa kontroluje, jakiej wielkości miniatury obrazków z naszej strony Google może używać w wynikach wyszukiwania. Dostępne ustawienia to:

- none: Nie pokazuj żadnych miniaturek obrazów.

- standard: Może być pokazana domyślna wielkość miniatury.

- large: Może być pokazana większa miniatura, co jest szczególnie korzystne w Google Discover.

Przykład: <meta name="robots" content="max-image-preview:large">

Noarchive

Instruuje wyszukiwarki, aby nie przechowywały w swojej pamięci podręcznej (cache) kopii strony. Użytkownik nie zobaczy linku „Kopia” obok wyniku wyszukiwania. Jest to przydatne dla stron, których treść zmienia się bardzo dynamicznie (np. Serwisy z wiadomościami na żywo) lub zawiera dane wrażliwe, których nie chcemy archiwizować.

Przykład: <meta name="robots" content="noarchive">

Unavailable_after:[data]

To niezwykle użyteczna, ale rzadko stosowana dyrektywa. Pozwala na ustawienie „daty ważności” strony. Po określonej dacie i godzinie (w formacie RFC 850) strona zostanie usunięta z indeksu Google. Idealne zastosowanie to strony dotyczące wydarzeń, ofert ograniczonych czasowo, promocji czy konkursów, które po zakończeniu tracą na aktualności.

Przykład: <meta name="robots" content="unavailable_after: 25 Aug 2024 15:00:00 PST">

Noimageindex

Prosta, ale potężna dyrektywa, która mówi robotom, aby nie indeksowały żadnych obrazków znajdujących się na tej konkretnej stronie. Strona jako całość nadal będzie indeksowana, ale jej grafiki nie pojawią się w wyszukiwarce Google Images. Może to być przydatne na stronach, gdzie obrazy mają charakter czysto ilustracyjny lub nie chcemy, aby były powiązane z naszą marką w kontekście graficznym.

Przykład: <meta name="robots" content="noimageindex">

Meta robots vs. X-robots-tag: kluczowe różnice i zastosowania

Chociaż meta tag robots jest najpopularniejszą metodą przekazywania dyrektyw, nie jest jedyną. Istnieje jego potężny odpowiednik, który działa na innym poziomie – X-Robots-Tag. Zrozumienie różnicy między nimi jest kluczowe dla pełnej kontroli nad indeksowaniem całej zawartości serwisu, a nie tylko stron HTML.

Meta Tag Robots:

- Jest implementowany jako tag

<meta>W sekcji<head>Dokumentu HTML. - Działa wyłącznie dla stron HTML. Nie można go użyć do kontrolowania indeksowania plików PDF, obrazów (JPG, PNG), dokumentów Word czy jakichkolwiek innych zasobów niebędących kodem HTML.

- Jest łatwy do wdrożenia dla osób z dostępem do kodu strony lub przez systemy CMS i wtyczki SEO.

X-Robots-Tag:

- Jest implementowany jako nagłówek odpowiedzi HTTP Wysyłany przez serwer.

- Jego największą zaletą jest to, że działa dla każdego typu pliku. Chcesz zablokować indeksowanie ważnego raportu w formacie PDF? Chcesz, aby cała biblioteka zdjęć była niedostępna dla Google Images? X-Robots-Tag jest rozwiązaniem.

- Implementacja jest bardziej techniczna. Zazwyczaj wymaga konfiguracji na poziomie serwera (np. W pliku

.htaccessNa serwerach Apache) lub w logice aplikacji backendowej.

Kiedy używać którego rozwiązania?

Pomyśl o tym w ten sposób: jeśli możesz edytować sekcję <head> Danego zasobu, użyj meta tagu robots. Dotyczy to wszystkich standardowych stron i podstron w Twojej witrynie. Jeśli jednak chcesz zarządzać indeksowaniem zasobów, które nie mają sekcji <head>, Musisz użyć X-Robots-Tag.

Przykładowe zastosowania X-Robots-Tag:

- Blokowanie plików PDF: Załóżmy, że oferujesz cennik lub wewnętrzny raport w formacie PDF do pobrania. Nie chcesz, aby był on dostępny bezpośrednio z poziomu wyników wyszukiwania Google. Możesz skonfigurować serwer tak, aby dla wszystkich plików .pdf wysyłał nagłówek

X-Robots-Tag: noindex. - Blokowanie obrazów: Masz folder ze zdjęciami, które są używane jako elementy tła lub nie powinny być indeksowane. Zamiast dodawać dyrektywę

noimageindexNa każdej stronie, możesz ustawić globalną regułę dla całego folderu. - Blokowanie dowolnych plików: Masz do pobrania pliki .docx, .xls, .zip. Każdy z nich może zostać zaindeksowany. X-Robots-Tag pozwala na centralne zarządzanie ich widocznością.

Warto pamiętać, że obie metody używają dokładnie tych samych dyrektyw (noindex, nofollow, noarchive Itd.). Różnica leży wyłącznie w sposobie i miejscu ich implementacji.

Jak prawidłowo wdrożyć i sprawdzić dyrektywy meta robots?

Teoretyczna wiedza o dyrektywach jest bezużyteczna bez umiejętności ich praktycznego zastosowania i weryfikacji. Prawidłowe wdrożenie jest kluczowe, aby uniknąć kosztownych błędów, a regularne sprawdzanie to podstawa technicznej higieny SEO.

Metody wdrażania

- Ręczna edycja kodu HTML: W przypadku prostych stron statycznych lub niestandardowych systemów, najprostszą metodą jest dodanie odpowiedniej linii kodu bezpośrednio w sekcji

<head>Każdej podstrony. To daje pełną kontrolę, ale jest niepraktyczne w dużych serwisach. - Systemy CMS i wtyczki SEO (najpopularniejsza metoda): Platformy takie jak WordPress, Joomla czy Drupal, w połączeniu z wtyczkami SEO (np. Yoast SEO, Rank Math, All in One SEO), oferują bardzo przyjazny interfejs do zarządzania tagami meta robots. Zazwyczaj w edytorze każdej strony lub wpisu znajduje się sekcja „Zaawansowane”, gdzie za pomocą prostego przełącznika lub pola wyboru można ustawić dyrektywę

noindexLub inne. - Ustawienia platform e-commerce: Platformy takie jak Shopify, Shoper czy PrestaShop często mają wbudowane globalne lub indywidualne ustawienia, które pozwalają wykluczyć z indeksowania określone typy stron (np. Koszyk, strony filtrowania).

Metody weryfikacji

Po wdrożeniu dyrektyw absolutnie konieczne jest sprawdzenie, czy działają one zgodnie z oczekiwaniami. Nigdy nie zakładaj, że system CMS lub wtyczka zrobiły to poprawnie.

- „Wyświetl źródło strony”: Najprostsza i najszybsza metoda. Otwórz stronę w przeglądarce, kliknij prawym przyciskiem myszy i wybierz „Wyświetl źródło strony” (lub podobną opcję). Następnie użyj funkcji szukania (Ctrl+F) i wpisz „robots”. Powinieneś odnaleźć tag

<meta name="robots" ...>I sprawdzić, jaka wartość znajduje się w atrybuciecontent. - Narzędzie do sprawdzania adresów URL w Google Search Console: To najbardziej wiarygodna metoda. Wklej adres URL, który chcesz sprawdzić, do paska na górze panelu Google Search Console. Narzędzie pokaże Ci, czy strona może być zaindeksowana. W sekcji „Indeksowanie strony” zobaczysz informację „Indeksowanie dozwolone: Tak” lub „Nie: wykryto tag „noindex””. To ostateczne potwierdzenie, jak Google widzi Twoje dyrektywy.

- Crawlery SEO: Narzędzia takie jak Screaming Frog SEO Spider, Ahrefs Site Audit czy SEMrush Site Audit mogą przeskanować całą Twoją witrynę i wygenerować raport, który pokaże, które strony mają ustawioną dyrektywę

noindexLub inne. Jest to najlepsza metoda do masowej weryfikacji i znajdowania błędów w dużych serwisach.

Najczęstsze błędy w stosowaniu meta robots i jak ich unikać

Meta tag robots to ostre narzędzie. Użyte prawidłowo, pomaga w optymalizacji. Użyte błędnie, może spowodować katastrofę w widoczności strony. Oto najczęstsze pułapki, na które należy uważać.

Błąd 1: Jednoczesne blokowanie w pliku robots.txt i tagu noindex

To klasyczny i bardzo częsty błąd. Plik robots.txt Służy do zarządzania dostępem robotów do zasobów (blokuje crawling), a meta robots Służy do zarządzania indeksowaniem (blokuje indexing). Jeśli zablokujesz stronę w robots.txt Za pomocą dyrektywy Disallow, Robot Google nigdy na nią nie wejdzie. W konsekwencji nigdy nie zobaczy tagu <meta name="robots" content="noindex">. Efekt? Strona, która już była w indeksie, w nim pozostanie. Co gorsza, Google może nadal indeksować sam adres URL (bez treści), jeśli znajdzie do niego linki z innych miejsc.

Rozwiązanie: Jeśli chcesz usunąć stronę z indeksu, upewnij się, że jest ona dostępna dla robotów w pliku robots.txt (Brak dyrektywy Disallow), Ale zawiera tag noindex.

Błąd 2: Przypadkowe pozostawienie tagu „noindex” na produkcyjnej wersji strony

To scenariusz z koszmarów każdego specjalisty SEO. Podczas prac deweloperskich często ustawia się globalny tag noindex, Aby wersja testowa nie dostała się do wyników wyszukiwania. Niestety, zdarza się, że podczas wdrożenia nowej wersji strony na serwer produkcyjny, ten tag nie zostaje usunięty. Efektem jest powolne lub gwałtowne znikanie całej witryny z wyników wyszukiwania Google.

Rozwiązanie: Stwórz listę kontrolną (checklist) przed każdym wdrożeniem. Jednym z najważniejszych punktów powinno być sprawdzenie globalnych ustawień indeksowania i usunięcie tagów noindex Z wersji produkcyjnej.

Błąd 3: Stosowanie dyrektywy „nofollow” na linkach wewnętrznych

Użycie <meta name="robots" content="nofollow"> Na całej stronie lub atrybutu rel="nofollow" Na linkach wewnętrznych jest zazwyczaj złym

Zobacz więcej:

- Ad inventory: Klucz do efektywnej reklamy online

- Czym jest engagement rate i jak go poprawić w email marketingu?

- Google Analytics 4: wszystko, co musisz wiedzieć, aby skutecznie mierzyć ruch

- Onboarding mailowy: jak skutecznie witać i angażować nowych użytkowników?

- White hat SEO: co to jest i dlaczego warto działać zgodnie z zasadami Google?

Dodaj komentarz