Techniczne SEO: kompletny przewodnik po optymalizacji strony internetowej

W dzisiejszym zatłoczonym cyfrowym świecie, samo posiadanie świetnej treści czy atrakcyjnego designu strony to za mało. Jeśli wyszukiwarki internetowe, na czele z Google, nie są w stanie skutecznie znaleźć, zrozumieć i ocenić Twojej witryny, cały Twój wysiłek marketingowy może pójść na marne. Tutaj właśnie na scenę wkracza techniczne SEO – Fundament, na którym opiera się cała widoczność w wynikach organicznych. To kręgosłup Twojej strategii SEO, który sprawia, że wszystkie inne działania mają sens.

Wielu marketerów i właścicieli firm postrzega techniczne SEO jako czarną magię, zarezerwowaną wyłącznie dla programistów. Prawda jest jednak taka, że zrozumienie jego podstaw jest kluczowe dla każdego, kto chce odnieść sukces online. W tym kompletnym przewodniku przeprowadzimy Cię przez wszystkie najważniejsze aspekty technicznej optymalizacji. Wyjaśnimy, czym jest, dlaczego ma tak ogromne znaczenie i jakie konkretne kroki możesz podjąć, aby Twoja strona była nie tylko przyjazna dla użytkowników, ale przede wszystkim dla robotów wyszukiwarek.

Czym jest techniczne SEO i dlaczego stanowi fundament sukcesu

Najprościej mówiąc, techniczne SEO To zbiór działań optymalizacyjnych, które nie dotyczą bezpośrednio treści strony, ale jej „wnętrza” – kodu, serwera i ogólnej architektury. Celem jest ułatwienie robotom wyszukiwarek (nazywanym też crawlerami lub pająkami) efektywnego indeksowania i zrozumienia struktury oraz zawartości witryny. Jeśli wyobrazimy sobie stronę internetową jako dom, to content marketing jest jego pięknym umeblowaniem, a link building to drogi prowadzące do tego domu. Techniczne SEO jest natomiast solidnym fundamentem, bez którego cały budynek grozi zawaleniem.

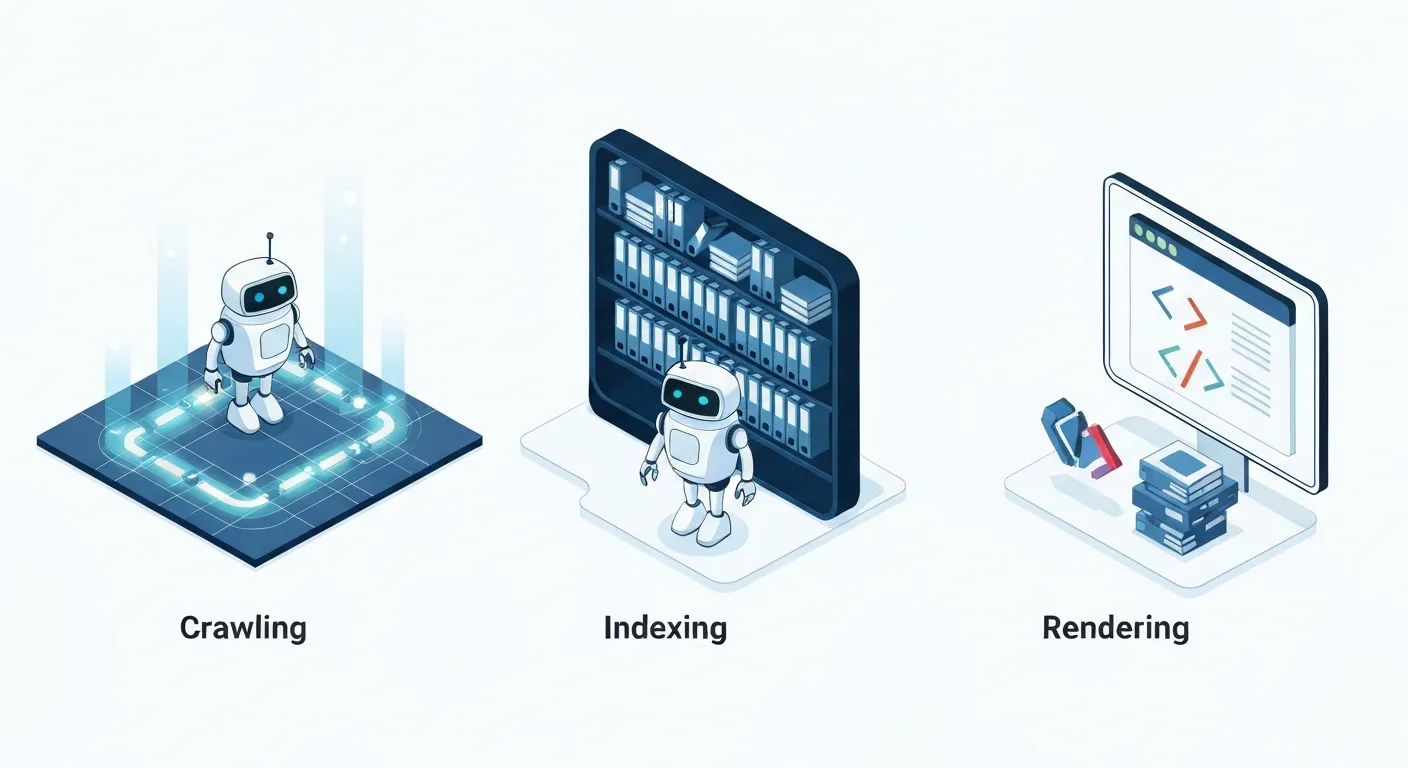

Główne zadania technicznego SEO obejmują trzy kluczowe etapy interakcji wyszukiwarki ze stroną:

- Crawlowanie (Crawlability): Czy roboty Google mogą bez problemu dotrzeć do wszystkich ważnych podstron Twojej witryny? Techniczne SEO dba o to, by nie było żadnych barier, takich jak błędna konfiguracja pliku robots.txt czy uszkodzone linki wewnętrzne.

- Indeksowanie (Indexability): Czy po odnalezieniu Twoich podstron, wyszukiwarka może je poprawnie dodać do swojego gigantycznego indeksu (biblioteki internetu)? Optymalizacja w tym zakresie obejmuje m.in. Zarządzanie tagami „noindex” czy poprawną implementację mapy strony.

- Renderowanie (Rendering): Czy Google jest w stanie poprawnie „zobaczyć” Twoją stronę tak, jak widzi ją użytkownik, zwłaszcza w kontekście stron opartych na JavaScript? To kluczowe dla zrozumienia pełnego kontekstu i zawartości.

Zaniedbanie technicznego SEO prowadzi do poważnych problemów. Nawet najlepszy artykuł na świecie nie zdobędzie pozycji w rankingu, jeśli Google nie będzie w stanie go znaleźć lub odczytać. Co więcej, wiele aspektów technicznych, takich jak szybkość ładowania czy responsywność, ma bezpośredni wpływ na doświadczenia użytkownika (UX), co jest jednym z najważniejszych czynników rankingowych.

Audyt i podstawowe narzędzia do technicznego SEO

Zanim zaczniesz wprowadzać zmiany, musisz wiedzieć, w jakim stanie technicznym jest Twoja witryna. Podstawą jest przeprowadzenie audytu technicznego SEO. Na szczęście nie musisz robić tego ręcznie. Istnieje wiele potężnych narzędzi, które wykonają za Ciebie większość pracy analitycznej.

Niezbędne narzędzia:

- Google Search Console (GSC): To absolutnie podstawowe i darmowe narzędzie od Google. Jest to Twoje centrum komunikacji z wyszukiwarką. GSC poinformuje Cię o problemach z indeksowaniem, błędach na stronie, stanie wskaźników Core Web Vitals, problemach z obsługą na urządzeniach mobilnych i wielu innych krytycznych aspektach. Regularne sprawdzanie raportu „Stan” (Coverage) jest obowiązkiem każdego specjalisty SEO.

- Screaming Frog SEO Spider: To desktopowy crawler, który symuluje działanie robota Google, skanując Twoją stronę. Jest to branżowy standard do przeprowadzania dogłębnych audytów. Narzędzie to pozwala zidentyfikować takie problemy jak: niedziałające linki (błędy 404), problemy z przekierowaniami (301, 302), zduplikowane tytuły i meta opisy, strony o zbyt małej zawartości, brakujące atrybuty alt w obrazkach i setki innych. Wersja darmowa pozwala przeskanować do 500 adresów URL.

- Narzędzia typu all-in-one (Ahrefs, Semrush, Moz): Te popularne platformy SEO, oprócz funkcji badania słów kluczowych i linków, oferują zaawansowane moduły do audytu witryny (Site Audit). Automatycznie skanują stronę w regularnych odstępach czasu i przedstawiają listę problemów wraz z priorytetami i wskazówkami, jak je naprawić.

- Google PageSpeed Insights: Kolejne darmowe narzędzie od Google, skoncentrowane na analizie szybkości ładowania strony i ocenie wskaźników Core Web Vitals, zarówno dla wersji mobilnej, jak i desktopowej. Dostarcza konkretnych rekomendacji, co należy poprawić, aby przyspieszyć witrynę.

Przeprowadzając audyt, skup się na zidentyfikowaniu największych problemów. Zacznij od błędów krytycznych (np. Masowe błędy 404, problemy z indeksacją kluczowych stron), a następnie przechodź do ostrzeżeń i rekomendacji. Systematyczne podejście jest tu kluczem do sukcesu.

Kluczowe elementy architektury i struktury strony

Dobra architektura strony jest jak dobrze zorganizowana biblioteka – zarówno użytkownicy, jak i roboty wyszukiwarek mogą łatwo znaleźć to, czego szukają. Logiczną i przemyślaną strukturę Google postrzega jako sygnał wysokiej jakości, co przekłada się na lepsze pozycje.

Struktura adresów URL

Adresy URL powinny być proste, czytelne i logiczne. Dobra praktyka to tworzenie tzw. „przyjaznych” adresów URL.

- Unikaj: `Twojadomena.pl/index.php?cat=1&id=123`

- Stosuj: `Twojadomena.pl/blog/techniczne-seo-przewodnik`

Krótkie, opisowe adresy zawierające słowo kluczowe są lepsze zarówno dla użytkowników (wiedzą, czego się spodziewać), jak i dla SEO. Staraj się utrzymywać płaską strukturę, unikając zbyt wielu poziomów zagnieżdżenia (np. `domena.pl/kategoria1/kategoria2/kategoria3/produkt`).

Nawigacja i linkowanie wewnętrzne

Linkowanie wewnętrzne to sieć połączeń między podstronami w obrębie Twojej domeny. Jest ono niezwykle ważne, ponieważ:

- Pomaga robotom odkrywać nowe treści: Crawlery podążają za linkami, aby znaleźć wszystkie podstrony.

- Rozprowadza „moc” (link juice): Linki ze stron o wysokim autorytecie (np. Strona główna) przekazują część swojej „mocy” do podstron, do których prowadzą.

- Pomaga Google zrozumieć kontekst i hierarchię: Strony, do których prowadzi wiele linków wewnętrznych z odpowiednim tekstem zakotwiczenia (anchor text), są postrzegane jako ważniejsze.

Kluczowe elementy dobrej nawigacji to logiczne menu główne, stosowanie tzw. „okruszków chleba” (breadcrumbs) oraz linkowanie kontekstowe w treści artykułów do innych, powiązanych tematycznie podstron.

Mapa strony XML (sitemap.xml)

Mapa strony XML to specjalny plik, który zawiera listę wszystkich ważnych adresów URL w Twojej witrynie. Jest to swoisty „spis treści” dla robotów Google, który ułatwia im znalezienie wszystkich podstron, które chcesz zaindeksować. Choć nie gwarantuje indeksacji, znacząco ją wspomaga, zwłaszcza w przypadku dużych serwisów lub stron o skomplikowanej strukturze. Pamiętaj, aby po utworzeniu mapy zgłosić jej lokalizację w Google Search Console.

Plik robots.txt

Plik `robots.txt` to prosty plik tekstowy umieszczony w głównym katalogu Twojej strony (np. `twojadomena.pl/robots.txt`). Jego zadaniem jest instruowanie robotów, do których części serwisu nie powinny mieć dostępu. Możesz go użyć, aby zablokować crawlowanie stron panelu administracyjnego, wyników wewnętrznej wyszukiwarki czy koszyka zakupowego. Należy jednak używać go z rozwagą – błędna konfiguracja może przypadkowo zablokować dostęp do ważnych zasobów i zaszkodzić widoczności strony.

Szybkość ładowania i doświadczenia użytkownika (Core Web Vitals)

Szybkość strony przestała być tylko miłym dodatkiem – stała się jednym z kluczowych czynników rankingowych. Google chce promować strony, które zapewniają użytkownikom pozytywne doświadczenia, a nikt nie lubi czekać na załadowanie się witryny. W 2021 roku Google wprowadziło tzw. Core Web Vitals (CWV), Czyli zbiór trzech konkretnych metryk oceniających UX.

Główne wskaźniki Core Web Vitals:

- Largest Contentful Paint (LCP): Mierzy czas potrzebny na załadowanie największego elementu (bloku tekstu, obrazu, wideo) w widocznym dla użytkownika obszarze strony. W uproszczeniu – ocenia postrzeganą prędkość ładowania. Dobry wynik to poniżej 2,5 sekundy.

- First Input Delay (FID) / Interaction to Next Paint (INP): FID mierzy czas od pierwszej interakcji użytkownika (np. Kliknięcia w link) do momentu, w którym przeglądarka jest w stanie na nią zareagować. INP, jego następca, ocenia ogólną responsywność strony. Wskaźniki te oceniają interaktywność.

- Cumulative Layout Shift (CLS): Mierzy stabilność wizualną strony. Ocenia, jak bardzo elementy na stronie „przeskakują” podczas ładowania. Wysoki CLS jest frustrujący dla użytkowników, którzy próbują kliknąć w przycisk, a ten nagle przesuwa się w inne miejsce.

Jak poprawić szybkość i Core Web Vitals?

- Optymalizacja obrazów: Kompresuj zdjęcia bez utraty jakości i używaj nowoczesnych formatów, takich jak WebP.

- Wykorzystaj buforowanie (caching): Skonfiguruj pamięć podręczną przeglądarki, aby powracający użytkownicy nie musieli za każdym razem pobierać wszystkich zasobów od nowa.

- Minifikacja kodu: Zmniejsz rozmiar plików CSS, JavaScript i HTML, usuwając z nich zbędne znaki (spacje, komentarze).

- Wybierz dobry hosting: Tani, współdzielony hosting często jest przyczyną wolnego działania strony. Inwestycja w szybszy serwer (np. VPS) może przynieść ogromne korzyści.

- Ogranicz zasoby blokujące renderowanie: Upewnij się, że skrypty i arkusze stylów są ładowane w sposób, który nie blokuje wyświetlania głównej treści strony.

Indeksowanie, renderowanie i dostępność dla robotów

Nawet najlepiej zoptymalizowana strona nie przyniesie korzyści, jeśli Google nie będzie w stanie jej poprawnie zaindeksować. W tej sekcji skupimy się na dyrektywach, które pozwalają zarządzać tym procesem.

Meta tagi robots

Meta tag `robots` umieszczany w sekcji „ Kodu HTML strony pozwala na precyzyjne sterowanie indeksowaniem na poziomie pojedynczej podstrony. Najważniejsze dyrektywy to:

- `index` / `noindex`: Informuje, czy strona ma być dodana do indeksu Google, czy nie. Używaj `noindex` dla stron o niskiej wartości (np. Strony z podziękowaniem za zakup, regulaminy).

- `follow` / `nofollow`: Informuje, czy roboty mają podążać za linkami znajdującymi się na danej stronie.

Najczęściej spotykane kombinacje to `index, follow` (domyślne zachowanie) oraz `noindex, follow` (strona nie jest w indeksie, ale roboty mają skanować linki na niej).

Kanonikalizacja (rel=”canonical”)

Zduplikowana treść to jeden z częstszych problemów technicznego SEO. Występuje, gdy ta sama lub bardzo podobna treść jest dostępna pod różnymi adresami URL (np. Przez parametry sortowania w sklepie internetowym). Tag kanoniczny (`rel=”canonical”`) to fragment kodu, który wskazuje wyszukiwarce, która wersja strony jest tą „oryginalną” i powinna być indeksowana. Pomaga to skonsolidować „moc” SEO na jednym adresie i uniknąć problemów z duplikacją.

Dane strukturalne (Schema.org)

Dane strukturalne to specjalny rodzaj znaczników dodawanych do kodu HTML, które pomagają wyszukiwarkom lepiej zrozumieć kontekst treści. Można powiedzieć, że to „SEO dla robotów”. Dzięki nim Google wie, że ciąg cyfr to cena produktu, ocena w gwiazdkach to opinia użytkownika, a lista kroków to przepis kulinarny. Prawidłowe wdrożenie danych strukturalnych może prowadzić do wyświetlania tzw. rich snippets (Wyników rozszerzonych) w wynikach wyszukiwania, takich jak oceny gwiazdkowe, ceny, czy sekcje FAQ, co znacząco zwiększa widoczność i współczynnik klikalności (CTR).

Optymalizacja pod kątem urządzeń mobilnych i bezpieczeństwo

W dobie wszechobecnych smartfonów, optymalizacja mobilna i bezpieczeństwo strony to absolutne podstawy, których nie można ignorować. Google już od kilku lat stosuje tzw. Mobile-First Indexing, Co oznacza, że do oceny i rankingu strony używa przede wszystkim jej wersji mobilnej.

Responsywny design (RWD)

Najlepszym i rekomendowanym przez Google podejściem jest Responsive Web Design. Strona responsywna automatycznie dostosowuje swój układ i zawartość do rozmiaru ekranu urządzenia, na którym jest wyświetlana. Oznacza to, że masz jedną wersję strony i jeden adres URL, co jest optymalne zarówno dla użytkowników, jak i dla robotów. Upewnij się, że na urządzeniach mobilnych wszystkie elementy są czytelne, przyciski łatwe do kliknięcia, a nawigacja intuicyjna.

Bezpieczeństwo (HTTPS)

Posiadanie certyfikatu SSL i korzystanie z protokołu HTTPS (charakterystyczna kłódka w pasku adresu przeglądarki) jest oficjalnym, choć lekkim, czynnikiem rankingowym. Jednak jego znaczenie wykracza daleko poza SEO. HTTPS szyfruje komunikację między przeglądarką użytkownika a serwerem, chroniąc dane przed przechwyceniem. Strony bez HTTPS są oznaczane przez przeglądarki jako „niezabezpieczone”, co odstrasza użytkowników i niszczy zaufanie do marki. W dzisiejszych czasach posiadanie certyfikatu SSL to absolutna konieczność.

Podsumowanie: techniczne SEO jako proces ciągły

Techniczne SEO Nie jest jednorazowym projektem, który można „odhaczyć” i o nim zapomnieć. To ciągły proces monitorowania, analizy i optymalizacji. Algorytmy Google stale się zmieniają, pojawiają się nowe technologie, a Twoja strona ewoluuje wraz z dodawaniem nowej treści. Regularne audyty techniczne, śledzenie raportów w Google Search Console i dbanie o higienę witryny są niezbędne do utrzymania i poprawy jej widoczności.

Pamiętaj, że nawet najlepsza strategia contentowa i najbardziej wartościowe linki zwrotne nie przyniosą oczekiwanych rezultatów, jeśli Twoja strona będzie stała na kruchym, technicznym fundamencie. Inwestycja czasu i zasobów w solidną optymalizację techniczną to najlepsza decyzja, jaką możesz podjąć, aby zapewnić swojej witrynie stabilny i długoterminowy wzrost w organicznych wynikach wyszukiwania.

Dodaj komentarz